Hadoop壓縮技術(shù)的概念-創(chuàng)新互聯(lián)

本篇內(nèi)容主要講解“Hadoop壓縮技術(shù)的概念”,感興趣的朋友不妨來(lái)看看。本文介紹的方法操作簡(jiǎn)單快捷,實(shí)用性強(qiáng)。下面就讓小編來(lái)帶大家學(xué)習(xí)“Hadoop壓縮技術(shù)的概念”吧!

1 概述

壓縮策略和原則

2 MR 支持的壓縮編碼

| 壓縮格式 | hadoop自帶 | 算法 | 文件擴(kuò)展名 | 是否可切分 | 換成壓縮格式后,原程序是否需要修改 |

|---|---|---|---|---|---|

| DEFLATE | 是,直接使用 | DEFLATE | .deflate | 否 | 和文本處理一樣,不需要修改 |

| Gzip | 是,直接使用 | DEFLATE | .gz | 否 | 和文本處理一樣,不需要修改 |

| bzip2 | 是,直接使用 | bzip2 | .bz2 | 是 | 和文本處理一樣,不需要修改 |

| LZO | 否,需要安裝 | LZO | .lzo | 是 | 需要建索引,還需要指定輸入格式 |

| Snappy | 否,需要安裝 | Snappy | .snappy | 否 | 和文本處理一樣,不需要修改 |

為了支持多種壓縮/解壓縮算法,Hadoop 引入了編碼/解碼器,如下表所示。

| 壓縮格式 | 對(duì)應(yīng)的編碼/解碼器 |

|---|---|

| DEFLATE | org.apache.hadoop.io.compress.DefaultCodec |

| gzip | org.apache.hadoop.io.compress.GzipCodec |

| bzip2 | org.apache.hadoop.io.compress.BZip2Codec |

| LZO | com.hadoop.compression.lzo.LzopCodec |

| Snappy | org.apache.hadoop.io.compress.SnappyCodec |

壓縮性能的比較

| 壓縮算法 | 原始文件大小 | 壓縮文件大小 | 壓縮速度 | 解壓速度 |

|---|---|---|---|---|

| gzip | 8.3GB | 1.8GB | 17.5MB/s | 58MB/s |

| bzip2 | 8.3GB | 1.1GB | 2.4MB/s | 9.5MB/s |

| LZO | 8.3GB | 2.9GB | 49.3MB/s | 74.6MB/s |

3 壓縮方式選擇

3.1 Gzip 壓縮

3.2 Bzip2 壓縮

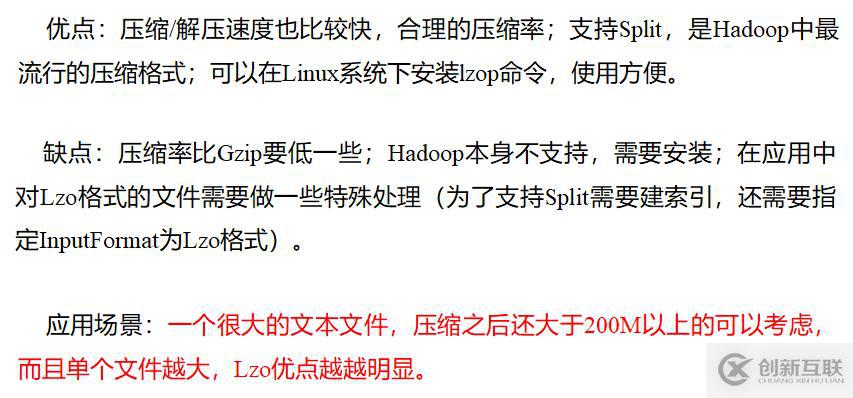

3.3 Lzo 壓縮

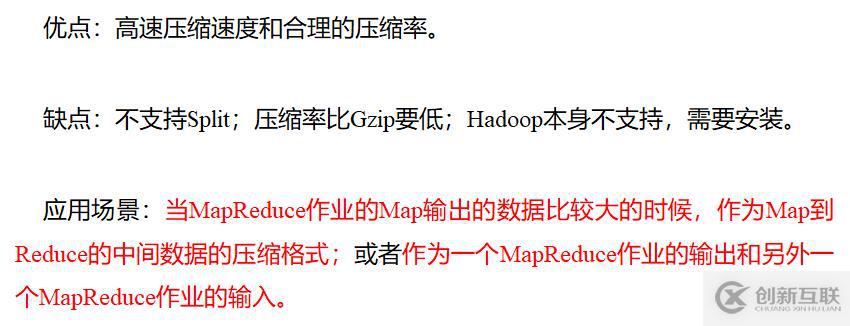

3.4 Snappy 壓縮

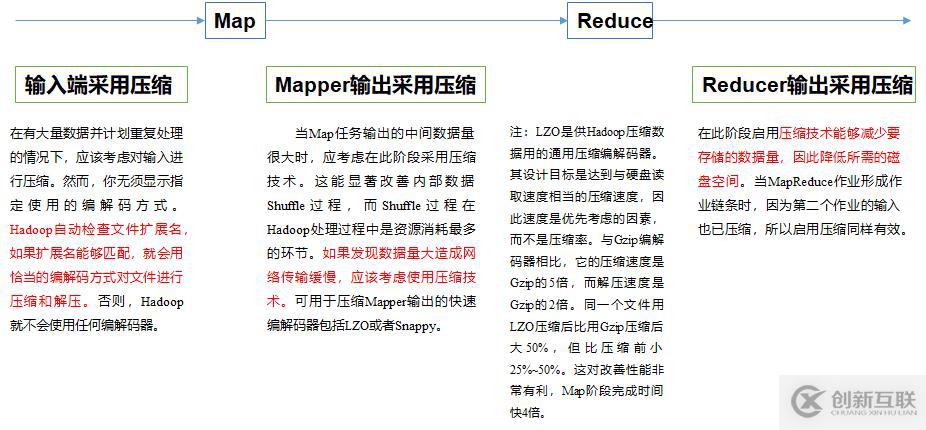

4 壓縮位置選擇

5 壓縮參數(shù)配置

| 參數(shù) | 默認(rèn)值 | 階段 |

|---|---|---|

| io.compression.codecs [在core-site.xml] | org.apache.hadoop.io.compress.DefaultCodecorg apache.hadoop.io.compress.GzipCodec org.apache.hadoop.io.compress.BZip2Codec | 輸入壓縮 |

| mapreduce.map.output.compress [mapred-site.xml] | false | mapper輸出 |

| mapreduce.map.output.compress.codec [mapred-site.xml] | org.apache.hadoop.io.compress.DefaultCodec | mapper輸出 |

| mapreduce.output.fileoutputformat.compress [mapred-site.xml] | false | reducer輸出 |

| mapreduce.output.fileoutputformat.compress.codec [mapred-site.xml] | org.apache.hadoop.io.compress DefaultCodec | reducer輸出 |

| mapreduce.output.fileoutputformat.compress.type [mapred-site.xml] | RECORD | reducer輸出 |

6 壓縮實(shí)操案例

6.1 數(shù)據(jù)流的壓縮和解壓縮

package com.djm.mapreduce.zip;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.io.compress.CompressionCodecFactory;

import org.apache.hadoop.io.compress.CompressionInputStream;

import org.apache.hadoop.io.compress.CompressionOutputStream;

import org.apache.hadoop.util.ReflectionUtils;

import java.io.*;

public class CompressUtils {

public static void main(String[] args) throws IOException, ClassNotFoundException {

compress(args[0], args[1]);

decompress(args[0]);

}

private static void decompress(String path) throws IOException {

CompressionCodecFactory factory = new CompressionCodecFactory(new Configuration());

CompressionCodec codec = (CompressionCodec) factory.getCodec(new Path(path));

if (codec == null) {

System.out.println("cannot find codec for file " + path);

return;

}

CompressionInputStream cis = codec.createInputStream(new FileInputStream(new File(path)));

FileOutputStream fos = new FileOutputStream(new File(path + ".decoded"));

IOUtils.copyBytes(cis, fos, 1024);

cis.close();

fos.close();

}

private static void compress(String path, String method) throws IOException, ClassNotFoundException {

FileInputStream fis = new FileInputStream(new File(path));

Class codecClass = Class.forName(method);

CompressionCodec codec = (CompressionCodec) ReflectionUtils.newInstance(codecClass, new Configuration());

FileOutputStream fos = new FileOutputStream(new File(path + codec.getDefaultExtension()));

CompressionOutputStream cos = codec.createOutputStream(fos);

IOUtils.copyBytes(fis, cos, 1024);

cos.close();

fos.close();

fis.close();

}

}6.2 Map 輸出端采用壓縮

package com.djm.mapreduce.wordcount;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.compress.BZip2Codec;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class WcDriver {

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

Configuration configuration = new Configuration();

configuration.setBoolean("mapreduce.map.output.compress", true);

// 設(shè)置map端輸出壓縮方式

configuration.setClass("mapreduce.map.output.compress.codec", BZip2Codec.class, CompressionCodec.class);

Job job = Job.getInstance(configuration);

job.setJarByClass(WcDriver.class);

job.setMapperClass(WcMapper.class);

job.setReducerClass(WcReduce.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

boolean result = job.waitForCompletion(true);

System.exit(result ? 0 : 1);

}

}6.3 Reduce 輸出端采用壓縮

package com.djm.mapreduce.wordcount;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.compress.BZip2Codec;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class WcDriver {

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

Configuration configuration = new Configuration();

Job job = Job.getInstance(configuration);

job.setJarByClass(WcDriver.class);

job.setMapperClass(WcMapper.class);

job.setReducerClass(WcReduce.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

// 設(shè)置reduce端輸出壓縮開(kāi)啟

FileOutputFormat.setCompressOutput(job, true);

// 設(shè)置壓縮的方式

FileOutputFormat.setOutputCompressorClass(job, BZip2Codec.class);

boolean result = job.waitForCompletion(true);

System.exit(result ? 0 : 1);

}

}到此,相信大家對(duì)“Hadoop壓縮技術(shù)的概念”有了更深的了解,不妨來(lái)實(shí)際操作一番吧!這里是創(chuàng)新互聯(lián)網(wǎng)站,更多相關(guān)內(nèi)容可以進(jìn)入相關(guān)頻道進(jìn)行查詢(xún),關(guān)注我們,繼續(xù)學(xué)習(xí)!

另外有需要云服務(wù)器可以了解下創(chuàng)新互聯(lián)scvps.cn,海內(nèi)外云服務(wù)器15元起步,三天無(wú)理由+7*72小時(shí)售后在線,公司持有idc許可證,提供“云服務(wù)器、裸金屬服務(wù)器、高防服務(wù)器、香港服務(wù)器、美國(guó)服務(wù)器、虛擬主機(jī)、免備案服務(wù)器”等云主機(jī)租用服務(wù)以及企業(yè)上云的綜合解決方案,具有“安全穩(wěn)定、簡(jiǎn)單易用、服務(wù)可用性高、性?xún)r(jià)比高”等特點(diǎn)與優(yōu)勢(shì),專(zhuān)為企業(yè)上云打造定制,能夠滿足用戶(hù)豐富、多元化的應(yīng)用場(chǎng)景需求。

新聞標(biāo)題:Hadoop壓縮技術(shù)的概念-創(chuàng)新互聯(lián)

分享URL:http://www.chinadenli.net/article8/deeiip.html

成都網(wǎng)站建設(shè)公司_創(chuàng)新互聯(lián),為您提供網(wǎng)站制作、外貿(mào)網(wǎng)站建設(shè)、網(wǎng)站改版、網(wǎng)站營(yíng)銷(xiāo)、ChatGPT、域名注冊(cè)

聲明:本網(wǎng)站發(fā)布的內(nèi)容(圖片、視頻和文字)以用戶(hù)投稿、用戶(hù)轉(zhuǎn)載內(nèi)容為主,如果涉及侵權(quán)請(qǐng)盡快告知,我們將會(huì)在第一時(shí)間刪除。文章觀點(diǎn)不代表本網(wǎng)站立場(chǎng),如需處理請(qǐng)聯(lián)系客服。電話:028-86922220;郵箱:631063699@qq.com。內(nèi)容未經(jīng)允許不得轉(zhuǎn)載,或轉(zhuǎn)載時(shí)需注明來(lái)源: 創(chuàng)新互聯(lián)

猜你還喜歡下面的內(nèi)容

- 對(duì)網(wǎng)站排名所有影響因素中,哪個(gè)是重點(diǎn)的因素?

- python元組有什么用-創(chuàng)新互聯(lián)

- 創(chuàng)建XmlPullParser兩種方式-創(chuàng)新互聯(lián)

- Metasploit爆破tcpwrapped服務(wù)-創(chuàng)新互聯(lián)

- OracleRMAN還原時(shí)setnewname文件名有空格報(bào)錯(cuò)怎么辦-創(chuàng)新互聯(lián)

- Oracle基于Linux7下的安裝-創(chuàng)新互聯(lián)

- Python對(duì)接xray和微信實(shí)現(xiàn)自動(dòng)告警-創(chuàng)新互聯(lián)

- 解析建站公司價(jià)格為何如此之大 2017-07-15

- 網(wǎng)站建設(shè)價(jià)格為什么在不同的建站公司差別那么大 2014-03-21

- 從順德建站公司的角度談企業(yè)網(wǎng)站建設(shè)核心原則 2022-11-27

- 南陽(yáng)網(wǎng)站建設(shè)開(kāi)發(fā):告訴你如何選擇一家好的建站公司? 2021-10-22

- 什么樣的建站公司值得企業(yè)托付? 2016-11-26

- 成都建站公司與高質(zhì)量攜手同行 2016-12-23

- 棗莊百度快照推廣網(wǎng)絡(luò)建站公司_處事企業(yè)成長(zhǎng) 2023-01-20

- 廣州專(zhuān)業(yè)建站公司優(yōu)勢(shì)有哪些 2022-04-08

- 上海網(wǎng)站建設(shè)公司排名,哪家建站公司靠譜又比較專(zhuān)業(yè)? 2020-11-24

- 如何選擇適合自己的建站公司 2017-09-19

- 網(wǎng)站制作選擇專(zhuān)業(yè)建站公司的六大優(yōu)勢(shì) 2022-08-08

- 怎么去判斷一個(gè)建站公司的好壞? 2021-06-03