「圖像分類(lèi)」關(guān)于圖像分類(lèi)中類(lèi)別不平衡那些事

作者&編輯 | 郭冰洋

網(wǎng)站的建設(shè)創(chuàng)新互聯(lián)建站專(zhuān)注網(wǎng)站定制,經(jīng)驗(yàn)豐富,不做模板,主營(yíng)網(wǎng)站定制開(kāi)發(fā).小程序定制開(kāi)發(fā),H5頁(yè)面制作!給你煥然一新的設(shè)計(jì)體驗(yàn)!已為成都圍欄護(hù)欄等企業(yè)提供專(zhuān)業(yè)服務(wù)。

1 簡(jiǎn)介

小伙伴們?cè)诶霉矓?shù)據(jù)集動(dòng)手搭建圖像分類(lèi)模型時(shí),有沒(méi)有注意到這樣一個(gè)問(wèn)題呢——每個(gè)數(shù)據(jù)集不同類(lèi)別的樣本數(shù)目幾乎都是一樣的。這是因?yàn)椴煌?lèi)別的樣例數(shù)目差異較小,對(duì)分類(lèi)器的性能影響不大,可以在避免其他因素的影響下,充分反映分類(lèi)模型的性能。反之,如果類(lèi)別間的樣例數(shù)目相差過(guò)大,會(huì)對(duì)學(xué)習(xí)過(guò)程造成一定的影響,從而導(dǎo)致分類(lèi)模型的性能變差。這就是本篇文章將要討論的類(lèi)別不平衡問(wèn)題(Class Imbalance)。

類(lèi)別不平衡是指分類(lèi)任務(wù)中不同類(lèi)別的訓(xùn)練樣本數(shù)目相差較大的情況,通常是由于樣本較難采集或樣本示例較少而引起的,經(jīng)常出現(xiàn)在疾病類(lèi)別診斷、欺詐類(lèi)型判別等任務(wù)中。

盡管在傳統(tǒng)機(jī)器學(xué)習(xí)領(lǐng)域內(nèi),有關(guān)類(lèi)別不平衡的問(wèn)題已經(jīng)得到了詳盡的研究,但在深度學(xué)習(xí)領(lǐng)域內(nèi),其相關(guān)探索隨著深度學(xué)習(xí)的發(fā)展,經(jīng)歷了一個(gè)先抑后揚(yáng)的過(guò)程。

在反向傳播算法誕生初期,有關(guān)深度學(xué)習(xí)的研究尚未成熟,但仍有相關(guān)科研人員研究過(guò)類(lèi)別樣例的數(shù)目對(duì)梯度傳播的影響,并得出樣例數(shù)目較多的類(lèi)別在反向傳播時(shí)對(duì)權(quán)重占主導(dǎo)地位。這一現(xiàn)象會(huì)使網(wǎng)絡(luò)訓(xùn)練初期,快速的降低數(shù)目較多類(lèi)別的錯(cuò)誤率,但隨著訓(xùn)練的迭代次數(shù)增加,數(shù)目較少類(lèi)的錯(cuò)誤率會(huì)隨之上升[1]。

隨后的十余年里,由于深度學(xué)習(xí)受到計(jì)算資源的限制、數(shù)據(jù)集采集的難度較大等影響,相關(guān)研究并沒(méi)有得到進(jìn)一步的探索,直到近年來(lái)才大放異,而深度學(xué)習(xí)領(lǐng)域內(nèi)的類(lèi)別不平衡問(wèn)題,也得到了更加深入的研究。

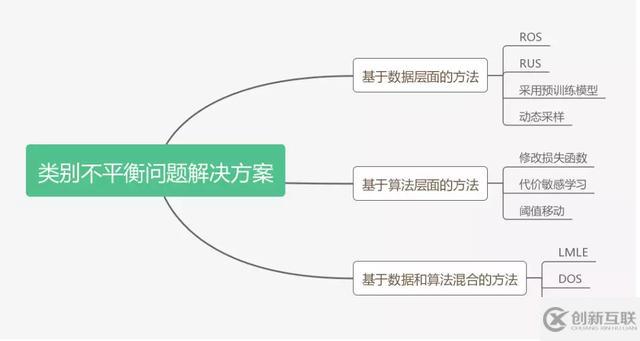

本篇文章將對(duì)目前涉及到的相關(guān)解決方案進(jìn)行匯總,共分為數(shù)據(jù)層面、算法層面、數(shù)據(jù)和算法混合層面三個(gè)方面,僅列舉具有代表性的方案闡述,以供讀者參考。

2 方法匯總

1、基于數(shù)據(jù)層面的方法

基于數(shù)據(jù)層面的方法主要對(duì)參與訓(xùn)練的數(shù)據(jù)集進(jìn)行相應(yīng)的處理,以減少類(lèi)別不平衡帶來(lái)的影響。

Hensman等[2]提出了 提升樣本(over sampling)的方法,即對(duì)于類(lèi)別數(shù)目較少的類(lèi)別,從中隨機(jī)選擇一些圖片進(jìn)行復(fù)制并添加至該類(lèi)別包含的圖像內(nèi),直到這個(gè)類(lèi)別的圖片數(shù)目和最大數(shù)目類(lèi)的個(gè)數(shù)相等為止。通過(guò)實(shí)驗(yàn)發(fā)現(xiàn),這一方法對(duì)最終的分類(lèi)結(jié)果有了非常大的提升。

Lee等[3]提出了一種 兩階段(two-phase)訓(xùn)練法。首先根據(jù)數(shù)據(jù)集分布情況設(shè)置一個(gè)閾值N,通常為最少類(lèi)別所包含樣例個(gè)數(shù)。隨后對(duì)樣例個(gè)數(shù)大于閾值的類(lèi)別進(jìn)行隨機(jī)抽取,直到達(dá)到閾值。此時(shí)根據(jù)閾值抽取的數(shù)據(jù)集作為第一階段的訓(xùn)練樣本進(jìn)行訓(xùn)練,并保存模型參數(shù)。最后采用第一階段的模型作為預(yù)訓(xùn)練數(shù)據(jù),再在整個(gè)數(shù)據(jù)集上進(jìn)行訓(xùn)練,對(duì)最終的分類(lèi)結(jié)果有了一定的提升.

Pouyanfar等[4]則提出了一種 動(dòng)態(tài)采樣(dynamic sampling)的方法。該方法借鑒了提升樣本的思想,將根據(jù)訓(xùn)練結(jié)果對(duì)數(shù)據(jù)集進(jìn)行動(dòng)態(tài)調(diào)整,對(duì)結(jié)果較好的類(lèi)別進(jìn)行隨機(jī)刪除樣本操作,對(duì)結(jié)果較差的類(lèi)別進(jìn)行隨機(jī)復(fù)制操作,以保證分類(lèi)模型每次學(xué)習(xí)都能學(xué)到相關(guān)的信息。

2、基于算法層面的方法

基于算法層面的方法主要對(duì)現(xiàn)有的深度學(xué)習(xí)算法進(jìn)行改進(jìn),通過(guò)修改損失函數(shù)或?qū)W習(xí)方式的方法來(lái)消除類(lèi)別不平衡帶來(lái)的影響。

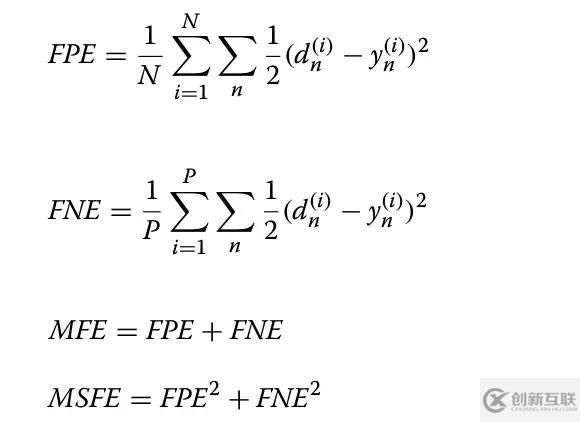

Wang等[5]提出 mean squared false error (MSFE) loss。這一新的損失函數(shù)是在mean false error (MFE) loss的基礎(chǔ)上進(jìn)行改進(jìn),具體公式如下圖所示:

MSFE loss能夠很好地平衡正反例之間的關(guān)系,從而實(shí)現(xiàn)更好的優(yōu)化結(jié)果。

Buda等[6]提出 輸出閾值(output thresholding)的方法,通過(guò)調(diào)整網(wǎng)絡(luò)結(jié)果的輸出閾值來(lái)改善類(lèi)別不平衡的問(wèn)題。模型設(shè)計(jì)者根據(jù)數(shù)據(jù)集的構(gòu)成和輸出的概率值,人工設(shè)計(jì)一個(gè)合理的閾值,以降低樣本數(shù)目較少的類(lèi)別的輸出要求,使得其預(yù)測(cè)結(jié)果更加合理。

3、基于數(shù)據(jù)和算法的混合方法

上述兩類(lèi)層面的方法均能取得較好的改善結(jié)果,如果將兩種思想加以結(jié)合,能否有進(jìn)一步的提升呢?

Huang等[7]提出 Large Margin Local Embedding (LMLE)的方法,采用五倍抽樣法(quintuplet sampling )和tripleheader hinge loss函數(shù),可以更好地提取樣本特征,隨后將特征送入改進(jìn)的K-NN分類(lèi)模型,能夠?qū)崿F(xiàn)更好的聚類(lèi)效果。除此之外,Dong等[8]則融合了難例挖掘和類(lèi)別修正損失函數(shù)的思想,同樣是在數(shù)據(jù)和損失函數(shù)進(jìn)行改進(jìn)。

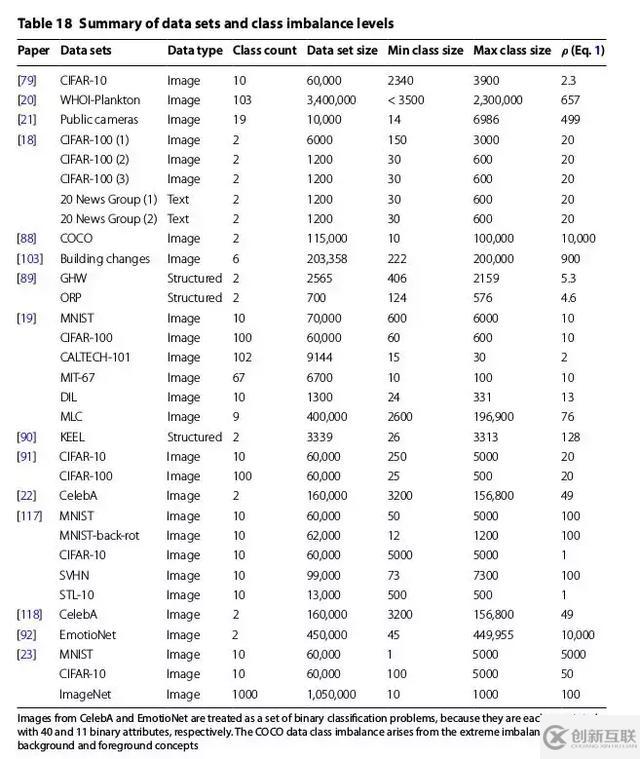

由于篇幅和時(shí)間有限,本文只列取了每個(gè)類(lèi)別的典型解決方案。同時(shí)也搜集了關(guān)于解決類(lèi)別不平衡問(wèn)題的相關(guān)綜述文獻(xiàn),截圖如下:

具體名稱(chēng)可以借鑒參考文獻(xiàn)[9]。

3 參考文獻(xiàn)

[1] Anand R, Mehrotra KG, Mohan CK, Ranka S. An improved algorithm for neural network classification of imbalanced training sets. IEEE Trans Neural Netw. 1993;4(6):962–9.

[2] Hensman P, Masko D. The impact of imbalanced training data for convolutional neural networks. 2015.

[3] Lee H, Park M, Kim J. Plankton classification on imbalanced large scale database via convolutional neural networks with transfer learning. In: 2016 IEEE international conference on image processing (ICIP). 2016. p. 3713–7.

[4] Pouyanfar S, Tao Y, Mohan A, Tian H, Kaseb AS, Gauen K, Dailey R, Aghajanzadeh S, Lu Y, Chen S, Shyu M. Dynamic sampling in convolutional neural networks for imbalanced data classification. In: 2018 IEEE conference on multimedia information processing and retrieval (MIPR). 2018. p. 112–7.

[5] Wang S, Liu W, Wu J, Cao L, Meng Q, Kennedy PJ. Training deep neural networks on imbalanced data sets. In: 2016 international joint conference on neural networks (IJCNN). 2016. p. 4368–74.

[6] Buda M, Maki A, Mazurowski MA. A systematic study of the class imbalance problem in convolutional neural

networks. Neural Netw. 2018;106:249–59.

[7] Huang C, Li Y, Loy CC, Tang X. Learning deep representation for imbalanced classification. In: 2016 IEEE conference on computer vision and pattern recognition (CVPR). 2016. p. 5375–84.

[8] Dong Q, Gong S, Zhu X. Imbalanced deep learning by minority class incremental rectification. In: IEEE transactions on pattern analysis and machine intelligence. 2018. p. 1–1

[9] Justin M. Johnson and Taghi M. Khoshgoftaar.Survey on deep learning with class imbalance.Johnson and Khoshgoftaar J Big Data.(2019) 6:27

總結(jié)

以上就是關(guān)于類(lèi)別不平衡問(wèn)題的相關(guān)解決方案,詳細(xì)內(nèi)容可以閱讀參考文獻(xiàn)綜述9,相信通過(guò)更加詳細(xì)的文章閱讀,你會(huì)收獲更多的經(jīng)驗(yàn)!

https://www.toutiao.com/a6727841366342107655/

網(wǎng)站欄目:「圖像分類(lèi)」關(guān)于圖像分類(lèi)中類(lèi)別不平衡那些事

網(wǎng)頁(yè)URL:http://www.chinadenli.net/article30/gooeso.html

成都網(wǎng)站建設(shè)公司_創(chuàng)新互聯(lián),為您提供App設(shè)計(jì)、網(wǎng)站建設(shè)、外貿(mào)網(wǎng)站建設(shè)、品牌網(wǎng)站設(shè)計(jì)、網(wǎng)站改版、全網(wǎng)營(yíng)銷(xiāo)推廣

聲明:本網(wǎng)站發(fā)布的內(nèi)容(圖片、視頻和文字)以用戶(hù)投稿、用戶(hù)轉(zhuǎn)載內(nèi)容為主,如果涉及侵權(quán)請(qǐng)盡快告知,我們將會(huì)在第一時(shí)間刪除。文章觀(guān)點(diǎn)不代表本網(wǎng)站立場(chǎng),如需處理請(qǐng)聯(lián)系客服。電話(huà):028-86922220;郵箱:631063699@qq.com。內(nèi)容未經(jīng)允許不得轉(zhuǎn)載,或轉(zhuǎn)載時(shí)需注明來(lái)源: 創(chuàng)新互聯(lián)

- 『微信公眾號(hào)運(yùn)營(yíng)技巧』這些技巧你得知道 2022-06-18

- 微信公眾號(hào)粉絲的粘性怎么提高? 2014-05-26

- 微信公眾號(hào)文章標(biāo)題制作有什么技巧 2022-11-07

- 微信公眾號(hào)商城如何運(yùn)營(yíng)? 2022-05-20

- 微信公眾號(hào)文章標(biāo)題制作有什么技巧-大連微信開(kāi)發(fā) 2022-07-12

- 微信公眾號(hào)平臺(tái)開(kāi)發(fā)運(yùn)營(yíng),剛好你需要,剛好我專(zhuān)業(yè),考慮考慮! 2022-08-17

- 企業(yè)微信公眾號(hào)運(yùn)營(yíng)的10個(gè)準(zhǔn)則是什么? 2014-01-23

- 微信公眾號(hào)運(yùn)營(yíng)怎么進(jìn)行布局? 2015-01-10

- 淘寶賣(mài)家怎樣運(yùn)營(yíng)微信公眾號(hào)? 2014-07-27

- 微信公眾號(hào)推送內(nèi)容應(yīng)該避免那些錯(cuò)誤? 2014-05-18

- 微信公眾號(hào)文章修改錯(cuò)別字需要注意什么? 2014-05-20

- 微信公眾號(hào)叕改版了,這里有最全改版信息匯總,還有微信官方改版解答! 2022-05-21